உலகை அழிக்கும் ரகசிய ஃபார்முலாக்கள் இப்போது ஏஐ நிறுவனங்களின் கைகளில்! மனிதக் குலத்தின் அழிவுக்கு கார்ப்பரேட் நிறுவனங்கள் எப்படித் துணைபோகின்றன?

கார்ப்பரேட் லாபத்திற்கும் மனித உயிர்களுக்கும் இடையிலான பனிப்போர் – இது குறித்த முழுமையான அலசல் இக்கட்டுரையில்!

செயற்கை நுண்ணறிவு (AI) இன்று மனிதக் குலத்தின் உச்சபட்ச சாத்தியம். அதே சமயம், நமது சவக்குழியை நாமே தோண்டிக் கொள்ளும் கருவியாகவும் அது மாறக்கூடும். நவீனப் போரியலில் AI-யின் ஊடுருவல், இதுவரை உலகம் கண்டிராத நெறிமுறைச் சிக்கல்களையும், அதிகாரப் போட்டிகளையும் உருவாக்கியுள்ளது.

இந்த அபாயகரமான சதுரங்க வேட்டையில், அமெரிக்காவின் முன்னணி AI நிறுவனமான ‘ஆந்த்ரோபிக்’ (Anthropic) சிக்கியிருக்கும் முரண்பாடுகளின் வலை, ஒரு அறிவியல் புனைவை விடவும் படுபயங்கரமானது.

ஒருபுறம், தீவிரவாதிகள் அல்லது தனிநபர்கள் தங்கள் AI மாடலான ‘க்ளாட்’டை (Claude) பயன்படுத்தி ரசாயன ஆயுதங்களையோ, கதிரியக்கக் குண்டுகளையோ தயாரித்துவிடக் கூடாது என்பதில் ஆந்த்ரோபிக் நிறுவனம் அதீத கவனம் செலுத்துகிறது.

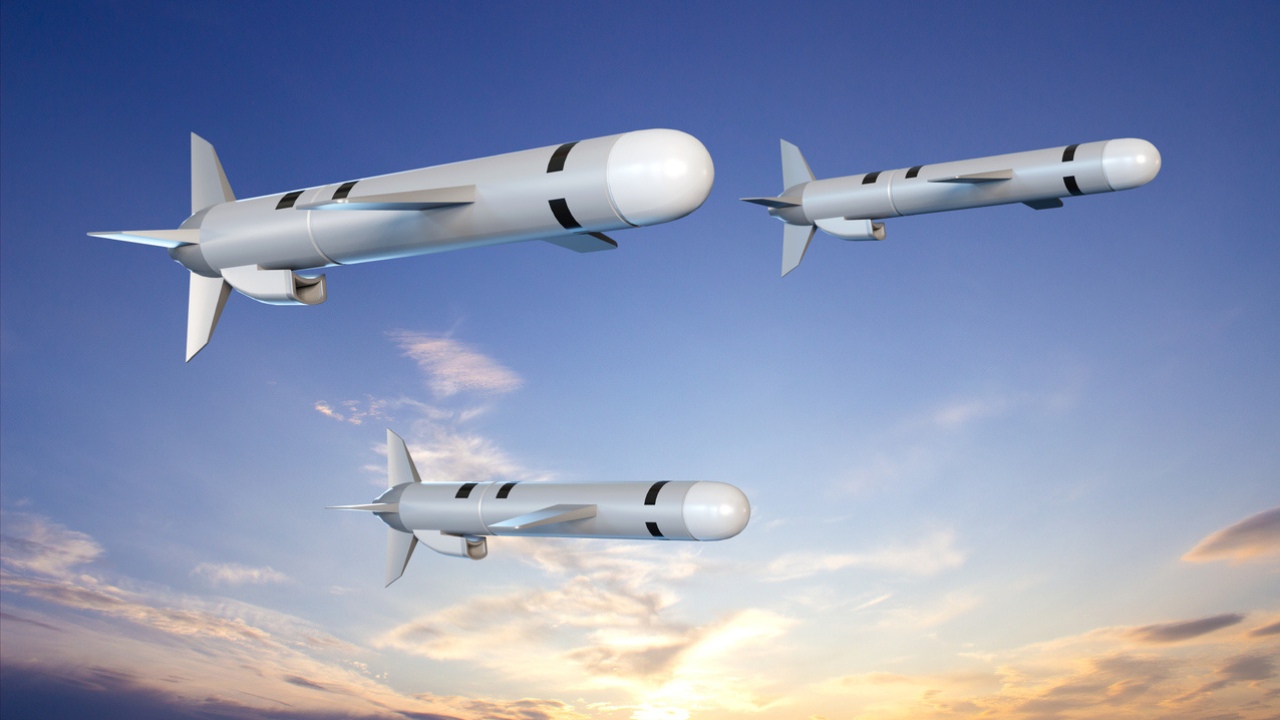

அதற்காக, பல லட்சம் டாலர்கள் சம்பளத்தில் ஆயுத நிபுணர்களை வேலைக்கு எடுக்கிறது. ஆனால் மறுபுறம்? அதே ‘க்ளாட்’ AI, பலாண்டீர் (Palantir) போன்ற மூன்றாம் தரப்பு நிறுவனங்கள் மூலமாக, அமெரிக்க-இஸ்ரேல்-ஈரான் போரில் (ஆபரேஷன் எபிக் ஃப்யூரி) ஏவுகணைகளுக்கு இலக்கு நிர்ணயிக்கும் மூளையாகச் செயல்பட்டுக் கொண்டிருக்கிறது.

உயிரைக் காக்க ஒரு பில்லியன் டாலர், உயிரைப் பறிக்க இன்னொரு பில்லியன் டாலர். இதுதான் இன்றைய சிலிக்கான் வேலியின் ரத்தச் சரித்திரம்.

ஆந்த்ரோபிக்கின் `பாதுகாப்பு’ தத்துவம்

ஆந்த்ரோபிக் நிறுவனம் தன்னை ஒரு மக்கள் நல நிறுவனமாகவே அடையாளப்படுத்திக் கொள்கிறது. AI தொழில்நுட்பம் உலகை அழித்துவிடக் கூடாது என்ற பெருங்கவலையைத் தொடர்ந்து பொதுவெளியில் பேசி வருபவர்கள் அவர்கள்!

ஒரு சாதாரண மனிதன், லேப்டாப்பைத் திறந்து, “ஒரு ரசாயன குண்டை எப்படித் தயாரிப்பது?” என்று கேட்டால், AI உடனே செய்முறையைத் தரக்கூடாது.

அந்தத் தகவலைத் தடுத்து நிறுத்த, AI-க்கு வலுவான கடிவாளங்கள் தேவை. இதைச் சாத்தியப்படுத்த, ஆந்த்ரோபிக் ஒரு பிரத்யேகமான ஆட்சேர்ப்பை நடத்தியது.

ரசாயன ஆயுதங்கள் மற்றும் அதிபயங்கர வெடிபொருட்கள் கொள்கை மேலாளர் (Policy Manager for Chemical Weapons and High Yield Explosives) என்ற பதவிக்கு அவர்கள் வெளியிட்ட விளம்பரம் பகீரென்று இருந்தது.

ராணுவம் அல்லது வெடிபொருள் தடுப்புப் பிரிவில் குறைந்தது ஐந்து வருட முன் அனுபவம் இருக்க வேண்டும். குறிப்பாக, ‘டர்ட்டி பாம்ஸ்’ (Dirty bombs) எனப்படும் கதிரியக்கப் பரவல் சாதனங்கள் (Radiological dispersal devices) பற்றிய ஆழமான அறிவு கட்டாயம்.

சீசியம் குளோரைடு (Cesium chloride) போன்ற கதிரியக்கப் பொருட்களை வைத்து ஒரு நகரத்தின் 36 பிளாக்குகளை நாசமாக்கத் தேவையான அத்தனை தொழில்நுட்பங்களையும் அறிந்த ஒருவர்தான் ஆந்த்ரோபிக்கிற்குத் தேவை. எதற்காக?

ஒரு தீவிரவாதி இதற்கான செய்முறையை க்ளாட் ஏஐ-யிடம் கேட்டால், அது எந்தக் கட்டத்திலும் தகவலைக் கசியவிடக் கூடாது என்பதற்காக!

ஆனால், இதில் உள்ள மாபெரும் ஆபத்தை பிபிசி (BBC) தொழில்நுட்ப ஆய்வாளர் டாக்டர் ஸ்டெஃபானி ஹேர் (Dr. Stephanie Hare) அப்பட்டமாக உடைத்தார்.

“ஒரு AI-க்கு, ‘இதைச் செய்யாதே’ என்று கற்றுத்தர, முதலில் ‘இதை எப்படிச் செய்வது’ என்ற அத்தனை ரகசியங்களையும் அதன் மூளைக்குள் ஏற்ற வேண்டும்.

அதுவே மிகப்பெரிய ஆபத்தாயிற்றே! நாளை யாராவது ஹேக்கர்கள் அந்தத் தகவல்களைத் திருடினால் என்ன ஆவது?” என்ற அவரது கேள்விக்குத் தொழில்நுட்ப உலகில் பதிலே இல்லை.

உலகை அழிக்கக்கூடிய அத்தனை ரசாயனக் கலவைகளின் ஃபார்முலாக்களும் இப்போது ஒரு கார்ப்பரேட் நிறுவனத்தின் சர்வருக்குள் அடைபட்டுக் கிடக்கின்றன.

இதுவே மிகப்பெரிய ஆபத்தல்லவா? பணமா, அறமா?

ஓபன் ஏ.ஐ-யின் (OpenAI) வேட்டை

ஆந்த்ரோபிக் மட்டும்தான் இப்படிச் செய்கிறதா என்றால், இல்லை. சாட்ஜிபிடி-யை (ChatGPT) உருவாக்கிய ஓபன் ஏ.ஐ நிறுவனமும் இதே வேலையில் இறங்கியிருக்கிறது.

அவர்கள் உயிரியல் மற்றும் ரசாயன அபாயங்கள் குறித்த ஆய்வாளருக்கு $455,000 (சுமார் 3.7 கோடி ரூபாய்) வரை சம்பளம் கொடுக்கத் தயாராக இருக்கிறார்கள்.

இது ஆந்த்ரோபிக் கொடுப்பதை விட ஏறத்தாழ இரண்டு மடங்கு அதிகம். AI நிறுவனங்களுக்கு இடையிலான இந்தப் பனிப்போர், தார்மீக அறம் என்பதை விடவும், தனது சந்தையைத் தக்கவைப்பதற்கான அதிகாரப் போட்டி. இது வல்லுநர்களை வளைத்துப்போடும் ‘திறமைக்கான போட்டி’யாக மாறிவிட்டது.

தங்களின் ஏஐ தயாரிப்புகள் சந்தையில் எந்த தடையுமின்றி விற்கப்பட வேண்டும் என்றால், இது போன்ற பாதுகாப்பு ஏற்பாடுகள் அவசியம் என்பதைப் பெருநிறுவனங்கள் உணர்ந்துவிட்டன.

ஆந்த்ரோபிக் எப்படி ராணுவத்திற்குள் வந்து சேர்ந்தது?

ஆந்த்ரோபிக் நிறுவனம் தனது ஏஐ தொழில்நுட்பத்தை நேரடியாக அமெரிக்க ராணுவத்தின் போர்ப் பயன்பாட்டிற்காக விற்கவில்லை.

“மாப்ள இவருதான், ஆனா இவரு போட்டிருக்குற சட்டை என்னுது\” என்ற வகையில், மூன்றாம் தரப்பு ராணுவ ஒப்பந்த நிறுவனங்கள் (Third-party defense contractors) மூலமாகவே இது ராணுவ அமைப்புகளுக்குள் ஊடுருவியது.

ஆந்த்ரோபிக் நிறுவனத்தின் க்ளாட் ஏஐ, அமெரிக்காவின் மிகப்பெரிய தரவுப் பகுப்பாய்வு மற்றும் ராணுவ ஒப்பந்த நிறுவனமான ‘பாலன்டிர்’ (Palantir) அமைப்புகளுடன் இணைக்கப்பட்டது.

ஆந்த்ரோபிக் நிறுவனம் தனது தொழில்நுட்பத்தின் அடிப்படை கட்டமைப்பை (API) பாலன்டிர் போன்ற நிறுவனங்களுக்கு வழங்கியதால் (Palantir Maven + Claude), இறுதியில் அந்தத் தொழில்நுட்பம் எந்த மாதிரியான ராணுவத் தாக்குதல்களுக்குப் பயன்படுத்தப்படுகிறது என்பதைக் கண்காணிக்கும் நேரடிக் கட்டுப்பாட்டை அது இழந்தது.

இதன் விளைவாக, க்ளாட் AI, பாலன்டிர் நிறுவனத்தின் உளவு அமைப்புகளுக்குள் (Maven Smart System) ஒரு ‘முடிவெடுக்கும் இஞ்சினாக’ (Decision-support system) மாறி, போர்க்களங்களில் ஆயிரக்கணக்கான இலக்குகளைத் தீர்மானிக்கும் பணியில் பயன்படுத்தப்பட்டது.

பென்டகனுடன் மோதல்

தேசத்துரோகப் பட்டமும், நீதிமன்ற வழக்கும்</div></div>.<p>தனிநபர்களிடம் இருந்து உலகைக் காப்பாற்ற நினைக்கும் ஆந்த்ரோபிக், அரசாங்கத்தின் போர் வெறிக்குத் துணை போக மறுத்தது.

முழுக்க முழுக்க தன்னிச்சையாகச் செயல்படும் ஆயுதங்களுக்கும் (Fully Autonomous Weapons), அமெரிக்கக் குடிமக்களை ஒட்டுமொத்தமாகக் கண்காணிக்கும் திட்டங்களுக்கும் தங்களது AI பயன்படுத்தப்படக் கூடாது என்று அவர்கள் திட்டவட்டமாக மறுத்துவிட்டார்கள்.

ஆந்த்ரோபிக் சி.இ.ஓ டாரியோ அமோடி (Dario Amodei) கடந்த பிப்ரவரியில் மிகத் தெளிவாகச் சொன்னார்:

“போர்க்களத்தில் மனித உயிர்களைத் தீர்மானிக்கும் அளவுக்கு இந்தத் தொழில்நுட்பம் இன்னும் முதிர்ச்சியடையவில்லை. அது தவறான தகவல்களை (Hallucinations) தர வாய்ப்புள்ளது.”

டாரியோ அமோடி

இருந்தாலும், ரகசிய ராணுவக் கட்டமைப்புகளில் க்ளாட் ஏஐ இன்னும் 6 மாதங்கள் வரை பயன்படுத்தப்படும். அதனை ராணுவப் பயன்பாட்டிலிருந்து முழுமையாக நீக்கும் திட்டம் இருந்தாலும்,

அது உடனடியாக நடக்காது என்றும் அவர் தெளிவுபடுத்தியுள்ளார். ஆந்த்ரோபிக்கின் இந்த நிலைப்பாட்டால் ஆத்திரமடைந்த அமெரிக்கப் பாதுகாப்புத் துறை (DoD), அந்த நிறுவனத்தை ஒரு ‘விநியோகச் சங்கிலி அபாயம்’ (Supply chain risk) என்று அதிகாரபூர்வமாக முத்திரை குத்தியது.

சீன உளவு நிறுவனமான ‘ஹூவாய்’ (Huawei)-க்கு என்ன தண்டனை கொடுக்கப்பட்டதோ, அதே தண்டனை அமெரிக்க மண்ணில் பிறந்த ஒரு நிறுவனத்துக்கு, அவர்கள் அறத்தைக் கடைப்பிடித்ததற்காகக் கொடுக்கப்பட்டது.

அமெரிக்க அதிபர் ட்ரம்ப் ஆந்த்ரோபிக்கை “தீவிர இடதுசாரி AI நிறுவனம்” என்று வர்ணித்து, அரசாங்கப் பயன்பாட்டிற்குத் தடை விதித்தார்.

இதற்கு எதிராக ஆந்த்ரோபிக் தற்போது நீதிமன்றப் படியேறியுள்ளது. அரசின் இந்த பழிவாங்கும் நடவடிக்கையால் தங்கள் நிறுவனத்தின் வணிகம் கடுமையாகப் பாதிக்கப்படுவதாகக் கூறி, அமெரிக்கப் பாதுகாப்புத் துறைக்கு எதிராக ஆந்த்ரோபிக் நிறுவனம் நீதிமன்றத்தில் வழக்குத் தொடர்ந்தது.

அமெரிக்க வெள்ளை மாளிகையோ, “ராணுவத்தின் முடிவுகளைத் தொழில்நுட்ப நிறுவனங்கள் தீர்மானிக்க முடியாது” என்று கூறி ஆந்த்ரோபிக்கின் எதிர்ப்பை நிராகரித்தது.

மறுபக்கம் கூகுள், மைக்ரோசாஃப்ட், ஆன்ட்ரில் (Anduril) போன்ற பெரும் தொழில்நுட்ப நிறுவனங்கள் எவ்வித தயக்கமும் இன்றி ராணுவ ஒப்பந்தங்களில் முழுமையாக ஈடுபட்டுள்ளன.

‘ஓப்பன் ஏ.ஐ’ நிறுவனம், ஆந்த்ரோபிக்கைப் போல எந்த முரண்டு பிடிப்பும் இல்லாமல், “அமெரிக்கக் குடிமக்களைக் கண்காணிக்கப் பயன்படுத்தக் கூடாது” என்ற ஒற்றை வரியை மட்டுமே சேர்த்துக்கொண்டு, அமெரிக்க ராணுவத்துடனான தனது ஒப்பந்தங்களைச் சுமுகமாக முடித்துக்கொண்டது.

மக்களின் நலனுக்காக இலவசமாகச் செயற்கை நுண்ணறிவை வழங்க வேண்டும் என்று துவங்கப்பட்ட ‘ஓபன் ஏ.ஐ’ நிறுவனத்தின் தற்போதைய நிலை இதுதான். அறம், தார்மீகம் எல்லாமே வியாபாரத்தின் முன்னால் மண்டியிடும் என்பதன் சான்று இவை.

ரத்தக் களரியில்

ஈரான் போரில் ‘க்ளாட்ஆந்த்ரோபிக் நிறுவனம் நீதிமன்றத்தில் போராடிக் கொண்டிருக்க, நிஜப் போர்க்களத்தின் நிலவரமோ நேரெதிர். பலாண்டீர் (Palantir) என்ற மாபெரும் ராணுவ ஒப்பந்த நிறுவனத்தின் சிஸ்டம்களுக்குள் ஆந்த்ரோபிக்கின் ‘க்ளாட்’ AI ஏற்கனவே புதைக்கப்பட்டுவிட்டது.

அதை நீக்கும் திட்டம் எதுவும் இப்போது இல்லை என்பதை பலாண்டீர்-இன் CEO அலெக்ஸ் கார்ப் (Alex Karp) பகிரங்கமாகவே ஒப்புக்கொண்டுள்ளார்.

இதன் விபரீதம் 2026-ல் நடந்த அமெரிக்க-இஸ்ரேல்-ஈரான் போரில் (ஆபரேஷன் எபிக் ஃப்யூரி) அம்பலமானது. போரின் வேகத்தை AI அசுரத்தனமாக மாற்றிவிட்டது.

2003 ஈராக் போரில், இலக்குகளைத் தீர்மானிக்க நூற்றுக்கணக்கான ராணுவ வீரர்கள் தேவைப்பட்டார்கள்.

ஆனால் இப்போது ஈரானில், பலாண்டீர் மற்றும் க்ளாட் AI உதவியோடு வெறும் 20 வீரர்கள் அதே வேலையைச் செய்தார்கள்.

முதல் 24 மணி நேரத்தில் 1,000 இலக்குகள் அலசி ஆராயப்பட்டன. வெறும் 12 மணி நேரத்தில் ஈரான் மீது நூற்றுக்கணக்கில் தாக்குதல்கள் நடத்தப்பட்டன. ஒரு மனித மூளையால் கற்பனை கூடச் செய்து பார்க்க முடியாத வேகம்.

டோமாஹாக் (Tomahawk)

ஆனால் டாரியோ அமோடி பயந்தது போலவே, AI செய்த ஒரு பிழை போர்க்களத்தில் ஒரு கோரத்தாண்டவம் ஆடியது. மினாப் பள்ளித் தாக்குதல் (Minab school strike) என்று அழைக்கப்படும் அந்தத் துயரச் சம்பவத்தில், டோமாஹாக் (Tomahawk) ஏவுகணை தவறுதலாக ஒரு பள்ளிக்கூடத்தின் மீது விழுந்து 165 மாணவிகளின் உயிரைக் குடித்தது. இது குறித்த விசாரணைகள் இன்னும் தொடர்ந்து கொண்டுதான் இருக்கின்றன.

இஸ்ரேல்-காஸா மோதலில் ‘Lavender’ போன்ற AI அமைப்புகள் ஆயிரக்கணக்கான இலக்குகளை அடையாளம் காட்ட உதவியுள்ளன.

தற்போதைய உக்ரைன்-ரஷ்யா போரில் பகுதி தன்னியக்க ஆயுதங்கள் மற்றும் இலக்கு அடையாளம் காண AI பயன்படுத்தப்பட்டு வருகின்றன.

சட்டமும் இல்லை, சாட்சியும் இல்லை

இந்தத் தொழில்நுட்ப அசுரனைக் கட்டுப்படுத்த சர்வதேச அளவில் எந்தச் சட்டமும் இல்லை என்பதுதான் மிகப் பெரிய சோகம்.

ரசாயன ஆயுதத் தடை ஒப்பந்தம் (Chemical Weapons Convention) அல்லது அணு ஆயுதப் பரவல் தடை ஒப்பந்தம் (Nuclear Non-Proliferation Treaty) போல, போரில் AI பயன்பாட்டைக் கட்டுப்படுத்த எந்த விதமான சர்வதேச சட்டமும் இல்லை.

எல்லாமே தனியார் நிறுவனங்கள் மற்றும் அரசுகளின் கொள்கைகளைச் சார்ந்தே உள்ளது. எனினும், போரில் ஏஐ பயன்படுத்தப்படுவதை சீனா மற்றும் ரஷ்யா ஆகிய நாடுகள் கடுமையாகக் கண்டனம் செய்துள்ளன.

சட்ட வெற்றிடம் ஒருபுறம் இருந்தாலும், அதனைச் சரிசெய்யும் நடவடிக்கைகளும் முடுக்கிவிடப்பட்டுள்ளன. ஐரோப்பிய ஒன்றியம் தனது ‘EU AI Act’ மூலம் அதிக ஆபத்துள்ள ராணுவ ஏஐ (high-risk military AI) பயன்பாட்டிற்குக் கட்டுப்பாடுகளைக் கொண்டுவந்துள்ளது.

அமெரிக்க நாடாளுமன்றத்திலும் (Congress) இது தொடர்பான புதிய மசோதா ஒன்று விவாதத்திற்கு வரவுள்ளதாகத் தகவல்கள் தெரிவிக்கின்றன.

இதன் நீட்சியாக, 2026-ல் ஐக்கிய நாடுகள் சபையில் தன்னாட்சி பெற்ற கொடிய ஆயுதங்கள் (Lethal Autonomous Weapons Systems – LAWS) தொடர்பான ஒப்பந்தம் மீண்டும் தீவிரமாகப் பேசப்பட்டு வருகிறது.

.War vs Wealth: போர்ச் சூழலிலும் உங்கள் முதலீடு பாதுகாப்பாக இருக்க இதோ 5 ஸ்மார்ட் வழிகள்!.

இந்தியச் சூழலில் ஏஐ-யின் தாக்கம்

இந்த ஏஐ ராணுவப் பயன்பாட்டு அலை இந்தியாவையும் விட்டுவைக்கவில்லை. ராணுவப் பயன்பாட்டிற்கான செயற்கை நுண்ணறிவை மேம்படுத்த, பாதுகாப்பு ஆராய்ச்சி மற்றும் மேம்பாட்டு நிறுவனத்தில் (DRDO) ஒரு தனிப் பிரிவையே இந்தியா உருவாக்கியுள்ளது.

ஆந்த்ரோபிக் நிறுவனமும் அமெரிக்க அரசும் இன்று சந்திக்கும் இதே அறச் சிக்கலும், அதிகார முரண்பாடும் எதிர்காலத்தில் இந்தியாவிலும் கட்டாயம் எழக்கூடும்.

ஏஐ என்பது அலாவுதீனின் அற்புத விளக்கு. அதைத் தேய்க்கும் கைகள் யாருடையது என்பதைப் பொறுத்தே, வெளிவரும் பூதம் நமக்கு வீடுகட்டிக் கொடுக்குமா,

அல்லது நம் வீட்டைத் தீக்கிரையாக்குமா என்பது முடிவாகும். இதனால், மனிதனின் வாழ்வா, சாவா என்பதை ஒரு அல்காரிதம் தீர்மானிக்கும் நிலைக்கு நாம் தள்ளப்பட்டிருக்கிறோம்.

அறம் என்பது வெறும் காகிதங்களில் மட்டும் இருந்தால் மட்டும் போதாது. அல்காரிதத்திலும் இருக்க வேண்டும்.

மனித உயிர்களைக் காக்கிறோம் என்று சொல்லிக்கொண்டே, மறுபக்கம் பெரும் அழிவுக்குத் துணைபோகும் இந்த முரண்பாட்டின் முடிச்சு அவிழும் வரை, மனிதக் குலத்தின் மீதான கத்தி தொங்கிக்கொண்டேதான் இருக்கும்.